¿La IA comprende el término diversidad?

Los modelos generativos de imágenes siguen generando noticias, se publicó un artículo del New York Times An A.I.-Generated Picture Won an Art Prize. Artists Aren’t Happy.

Cubriendo las repercusiones de que el diseñador gráfico Jason Allen ganó un premio de arte digital o fotografía digitalmente manipulada utilizando como base una imagen generada por el modelo de AI Midjourney.

La declaración que la imagen ganadora había sido generada por un modelo generó una ola de controversia de si hay lugar en el arte para la Inteligencia Artificial, o si eso significa, nuevamente, que el arte ha muerto. Allen por su lado argumentaba que utilizar un modelo para implementar su idea no implica que no haya un desafío creativo. Subrayando la importancia de elegir las palabras necesarias para generar la imagen y que luego hay un trabajo como artista digital sobre la misma para mejorarla.

En Junio de este año salía la noticia de que Cosmo generaba por primera vez en el mundo una portada de revista mediante inteligencia artificial, utilizando el modelo Dalle-2, yendo tan lejos como acotando en la misma tapa que solo tomó 20 segundos hacerla.

En nuestro blog anterior ¿Cuál sería el diseño ideal de la camiseta alternativa de Uruguay? Pablo Molina utilizó 4 modelos de generación de imágenes, entre ellos Midjourney y Dalle-2, para reimaginar la camiseta alternativa de Uruguay.

Las aplicaciones para facilitar el diseño gráfico de imagen a texto son innegables y vienen ganando pie en las industrias. Algunas de ellas pueden ser generar imágenes sin derechos de autor, para reimaginar logos, ilustrar historias, cambiar el estilo a imágenes y porque no visualizar posibles productos a partir de bocetos.

Estos modelos nos deslumbran con sus potencialidades y están haciendo una competencia agresiva en el mundo del diseño gráfico. Sin embargo hay que entender sus limitaciones: los mismos trabajan a partir de frases cortas, escritas en inglés, para generar las imágenes. Allen tenía cierta razón en que saber transmitir lo que queremos es la parte inesquivable del proceso creativo.

Esta tarea de generar el texto correcto nos lleva a la eterna pregunta que potencia el procesamiento de lenguaje natural (NLP) desde sus orígenes, ¿Qué tanto estos modelos entienden lo que les pido? ¿Cómo me puedo comunicar de manera óptima para obtener la imagen que quiero?

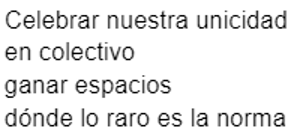

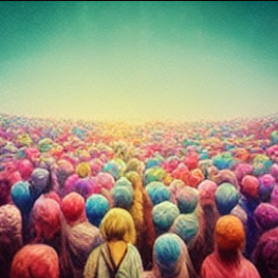

Terminando el año y conmemorando los 30 años de la primera marcha de la diversidad, quise aprovechar la oportunidad para testear el entendimiento de estos modelos sobre poesía, no pidiéndole directamente una imagen sobre diversidad, sino pasándole 4 poemas escritos en torno a mi sentir de la diversidad, para explorar qué concepto capta de algo tan subjetivo como el texto poético.

DreamStudio – Stable Difussion

DreamStudio – Stable Difussion

DreamStudio – Stable Difussion

DreamStudio – Stable Difussion

Una dificultad agregada de este experimento fue que los poemas están escritos en español y en la traducción también pierde un poco su estructura poética de todas maneras vimos cómo cada modelo hizo su interpretación.

Vemos como Mini Dall-e es un modelo más literal, podría ser más apropiado para generar imágenes cuando tenemos una idea precisa. Para casos en que podamos plasmar en pocas palabras, dado que vemos cómo se centra en palabras conocidas. Por ejemplo, en el poema “celebrar nuestra unicidad/ en colectivo/ ganar espacios/ dónde lo raro es la norma” recoge la palabra espacio para generar las imágenes.

Stable Difussion en DreamStudio considero que es apropiado para tareas creativas, su interpretación de los poemas es altamente interesante. Tiene incluso la opción de construir la imagen sobre una imagen base, ayudándonos a mejorar el diseño o adaptarlo a nuestra idea para por ejemplo trabajar en cambios de estilo o generar variedades de una imagen.

Mientras que Midjourney, también logró generar su propia interpretación de los poemas que creo que se acerca a un concepto genérico de los mismos. Sus imágenes tienen una apariencia un poco más hiperrealista que puede ayudar mucho a la ilustración. Adicionalmente, debido a que la interacción es mediante un servidor de discord, se pueden ver las imágenes generadas por la comunidad en tiempo real. Generando un catálogo de ejemplos de posibles imágenes sobre las cuáles inspirarse.

Por último, cierro este blog con un poema que no pude incluir en los modelos por ser muy largo, como una última reflexión sobre qué significa para mí la diversidad y porque la celebro.